Contenido revisado y publicado bajo la responsabilidad editorial de Ecosideral.

Los deepfakes representan una de las amenazas más sofisticadas de la era digital. Mediante técnicas de inteligencia artificial generativa, es posible crear videos, audios e imágenes hiperrealistas de personas diciendo o haciendo cosas que jamás ocurrieron. En 2026, la tecnología ha alcanzado un nivel de perfección que hace prácticamente imposible distinguir un deepfake de la realidad a simple vista, planteando desafíos sin precedentes para la democracia, la seguridad y la confianza social.

Cómo Funcionan los Deepfakes

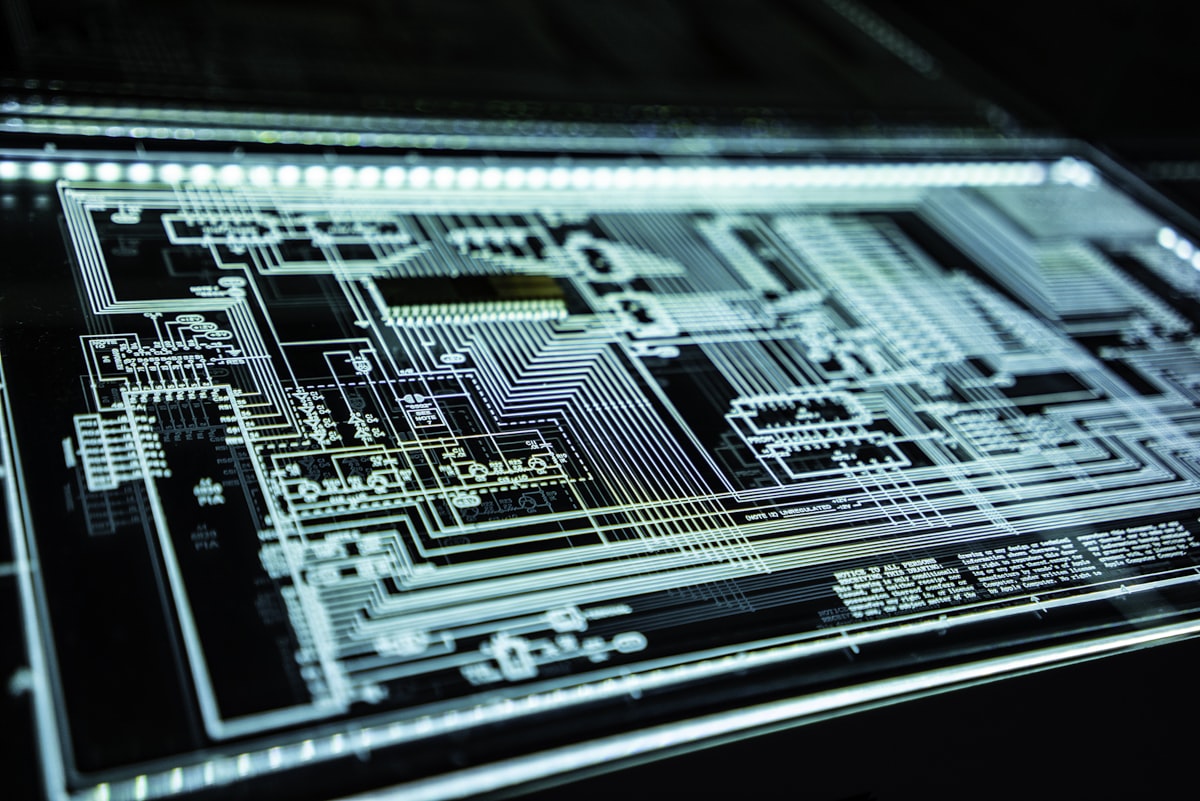

La tecnología detrás de los deepfakes se basa en redes generativas adversarias, conocidas como GANs por sus siglas en inglés. Este sistema utiliza dos redes neuronales que compiten entre sí: una genera contenido falso mientras la otra intenta detectarlo. A través de millones de iteraciones, la red generadora aprende a crear contenido cada vez más convincente hasta que la red detectora no puede distinguirlo del material auténtico. El resultado son imágenes y videos de una calidad sorprendente.

Los primeros deepfakes requerían miles de imágenes de la persona objetivo y horas de procesamiento en hardware especializado. En 2026, aplicaciones accesibles desde cualquier smartphone pueden generar deepfakes convincentes con apenas una fotografía y unos segundos de audio. Esta democratización de la tecnología ha multiplicado exponencialmente tanto los usos creativos legítimos como los maliciosos, creando un panorama complejo que la legislación vigente apenas puede abordar.

Los deepfakes de audio, conocidos como voice clones, son particularmente preocupantes. Con apenas 15 segundos de grabación de la voz de una persona, los algoritmos actuales pueden generar mensajes completamente nuevos que suenan idénticos al original. Esto ha dado lugar a nuevas formas de estafa telefónica donde los criminales imitan la voz de familiares o jefes para solicitar transferencias bancarias urgentes, causando pérdidas millonarias a nivel global.

Impacto en la Política y la Democracia

El uso de deepfakes en contextos políticos ha generado una crisis de confianza sin precedentes. Durante las elecciones de 2024 y 2025 en varios países, circularon videos manipulados de candidatos haciendo declaraciones polémicas que nunca realizaron. Aunque muchos fueron detectados y desmentidos, el daño ya estaba hecho: los votantes indecisos habían sido influenciados y la desconfianza hacia cualquier contenido audiovisual se había generalizado.

Este fenómeno ha creado una paradoja peligrosa conocida como el dividendo del mentiroso. Ahora, cualquier persona grabada haciendo o diciendo algo comprometedor puede alegar que se trata de un deepfake, incluso cuando el contenido es auténtico. Esta ambigüedad erosiona la capacidad de la sociedad para establecer hechos compartidos, un pilar fundamental de cualquier democracia funcional.

Gobiernos de todo el mundo están implementando regulaciones para combatir esta amenaza. La Unión Europea ha incluido los deepfakes en su Acta de Inteligencia Artificial, exigiendo que todo contenido generado por IA esté claramente etiquetado. Estados Unidos ha aprobado legislación específica que criminaliza la creación de deepfakes con intención de manipular elecciones. Sin embargo, la naturaleza transfronteriza de internet hace que la aplicación efectiva de estas leyes sea enormemente difícil.

Deepfakes en el Entretenimiento y la Industria

No todo es negativo en el mundo de los deepfakes. La industria del entretenimiento ha adoptado la tecnología para revolucionar la producción audiovisual. Estudios de Hollywood utilizan deepfakes para rejuvenecer actores, crear dobles digitales para escenas peligrosas y hasta resucitar artistas fallecidos para nuevas producciones. La película que utilizó IA para recrear digitalmente a un actor clásico generó tanto admiración técnica como debate ético sobre los derechos de imagen póstumos.

En el sector corporativo, la tecnología de deepfakes se utiliza para crear videos de formación personalizados, traducir presentaciones ejecutivas a múltiples idiomas manteniendo la voz y los gestos originales del orador, y generar contenido de marketing a escala. Empresas como Synthesia y HeyGen permiten crear videos profesionales con avatares digitales que hablan en decenas de idiomas, reduciendo drásticamente los costes de producción audiovisual.

La Carrera Armamentística: Creación versus Detección

Frente a la amenaza de los deepfakes, se ha desarrollado toda una industria dedicada a su detección. Empresas tecnológicas, universidades y gobiernos invierten millones en algoritmos capaces de identificar contenido manipulado. Estas herramientas analizan inconsistencias sutiles en la iluminación, los reflejos en los ojos, los patrones de parpadeo, las microexpresiones faciales y las frecuencias de audio para determinar si un contenido es auténtico o generado por IA.

Sin embargo, se trata de una carrera armamentística asimétrica. Cada mejora en la detección es utilizada por los creadores de deepfakes para perfeccionar sus técnicas, creando un ciclo interminable de escalada tecnológica. Los expertos coinciden en que la detección por sí sola no será suficiente y que se necesitan soluciones complementarias como marcas de agua digitales, sistemas de procedencia de contenido y educación mediática masiva.

Iniciativas como C2PA, respaldada por Microsoft, Adobe, Intel y la BBC, están desarrollando estándares de autenticidad para el contenido digital. Mediante firmas criptográficas embebidas en los archivos en el momento de su creación, es posible verificar la procedencia y la integridad de cualquier imagen, video o audio. Si bien esta tecnología no eliminará los deepfakes, proporcionará una herramienta para que los usuarios puedan verificar la autenticidad del contenido que consumen.

Protección Personal en la Era de los Deepfakes

A nivel individual, protegerse de los deepfakes requiere una combinación de precaución digital y pensamiento crítico. Limitar la cantidad de fotos y videos personales que se comparten públicamente reduce el material disponible para crear deepfakes. Utilizar autenticación de múltiples factores para verificar la identidad en comunicaciones sensibles es otra medida práctica. Y desarrollar un saludable escepticismo hacia contenido impactante que circula en redes sociales es quizás la defensa más importante de todas.

El Horizonte: Convivir con la Síntesis Digital

La realidad es que los deepfakes no van a desaparecer. La tecnología continuará mejorando y haciéndose más accesible. La sociedad necesita adaptarse a un mundo donde el contenido audiovisual ya no puede tomarse como prueba irrefutable de la realidad. Esto requiere inversión en educación mediática desde las escuelas, desarrollo de herramientas de verificación accesibles para todos, marcos regulatorios internacionales coordinados y un compromiso colectivo con la verdad. El futuro de la confianza digital depende de cómo respondamos a este desafío en los próximos años críticos.

Fuentes y actualización

Este artículo fue revisado editorialmente por Ecosideral.

Fuentes consultadas: documentación pública, publicaciones especializadas, anuncios oficiales y materiales de referencia relacionados con el tema tratado.

Última revisión editorial: noviembre de 2025.

Sobre Ecosideral

Ecosideral analiza las fuerzas tecnológicas que están redefiniendo el futuro: inteligencia artificial, innovación, espacio, ciencia y tendencias.

Conoce más →

Lo mas preocupante no son los deepfakes evidentes sino los sutiles. Un video ligeramente editado para cambiar el tono de una declaracion politica puede ser mas danino que una falsificacion obvia. Y para eso todavia no hay deteccion fiable.